先日情報処理学会第69回ユビキタスコンピューティングシステム(UBI)研究発表会で発表した学部3年別宮君らの研究が、優秀論文賞を受賞しました。

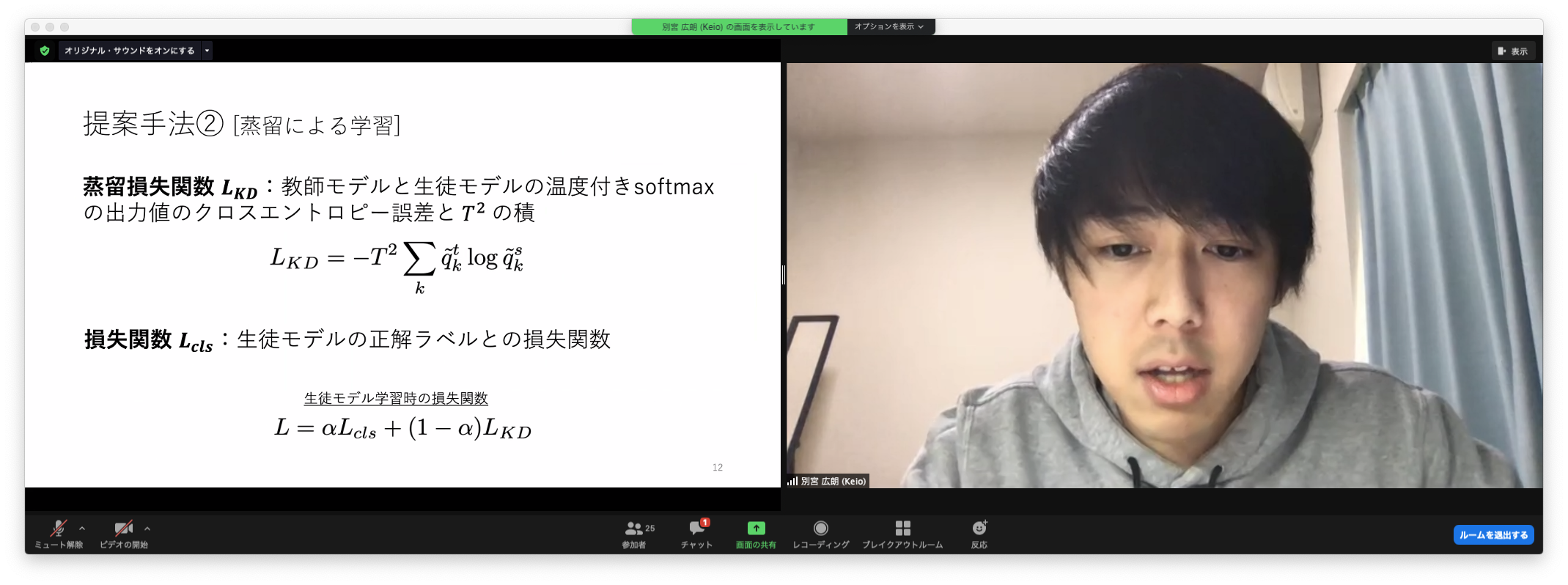

限られた計算資源で軽快に動作するニューラルネットワークモデル構築のための蒸留手法において、独自の評価関数やベイズ最適化を用い、 “推論速度重視”や”精度重視等”の目的に応じた圧縮のための最適な生徒 モデルの探索手法を開発しました。

別宮広朗, 小澤遼, 大越 匡, 中澤 仁, ベイズ最適化と蒸留を用いた最適な圧縮モデル探索手法の提案, 研究報告ユビキタスコンピューティングシステム(UBI), Vol.2021-UBI-69, No.10, pp1-8, 2021

http://id.nii.ac.jp/1001/00209495/近年, DeepLearning 技術が急激に発達し高精度なニューラルネットワークモデルが多数出現してお り, IoT デバイス等の様々なデバイスへ搭載することが期待される. ニューラルネットワークモデルは層や 重みパラメータが多いほど精度が向上する傾向があり, 高精度なモデルは推論時間が長くなる場合が多い. 計算資源の限られた IoT デバイス等の小型端末に搭載するためには, 限られた計算資源でも軽快に動作す るモデルの構築が求められる. 推論時間を削減する手法の一つとして, 蒸留という手法が存在する. 蒸留は 高精度な教師モデルの知識を小さい生徒モデルに学習させてニューラルネットワークの圧縮を行う技術で ある. しかし, 生徒モデルの任意性は高くトレードオフな関係にある推論速度と精度を両立するようなモデ ルの発見は困難である. また, 実際に小型端末に搭載する上で, アプリケーションの目的に応じて推論速度 や精度の重要度も変わるため, 目的に応じた圧縮を行える必要がある. そのため本研究では, 推論速度と精 度に最低値を設定した探索や推論速度と精度に比重を置いた探索を行うことを可能とする評価関数を定義 し, ベイズ最適化を用いて, 推論速度を重視, または精度を重視等の目的に応じた圧縮のための最適な生徒 モデルの探索手法を提案し, 検証実験を行う. 更に, 圧縮モデルの推論速度と精度の探索パレート最適解に よって得られた, 圧縮モデルが達成できる限界値の曲線を可視化する.