学部3年 青木君が研究内容を第28回 画像の認識・理解シンポジウム (MIRU2025) でポスター発表しました.

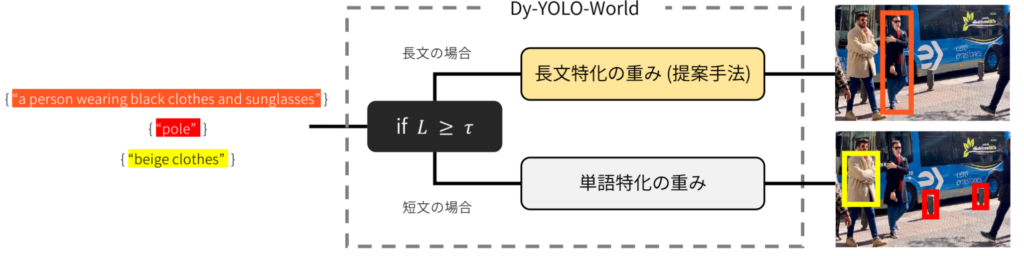

研究概要:本研究では,オープンボキャブラリー物体検出(OVD)における文脈理解性能とリアルタイム性の両立を目的として,YOLO-Worldアーキテクチャを拡張したDy-YOLO-Worldを提案する.YOLO-Worldは,軽量かつ高速なオープンボキャブラリー物体検出を実現する一方で,自然言語における文脈的意味の解釈に弱いという課題を抱えている.そこで本研究では,長文に最適化された「長文特化重み」を新たに学習し,従来の軽量なYOLO-Worldの重みと動的に切り替えて併用するアーキテクチャを導入する.長文重みの学習には,Flickr30k Entitiesデータセットを用いたファインチューニングを行い,複雑な自然言語指示への識別精度を向上させる.これにより,従来の推論効率を維持しつつ,より高い意味理解能力を備えたオープンボキャブラリー物体検出モデルの構築を目指す.実験の結果,提案手法は,Flickr30k EntitiesとCOCO 2017を統合した長文・短文混在のテストセットにおいて,既存のYOLO-Worldを上回る性能を示した.